CNN和Transformer创新结合,模型性能炸裂!

发布时间:2024-09-03

近年来,卷积神经网络(CNN)和Transformer在各自的领域内都取得了显著的成果。然而,这两种模型也存在各自的局限性。为了克服这些局限性,越来越多的研究者开始探索如何将CNN和Transformer进行结合,设计出可以将两者优势互相补充的混合模型。这种结合不仅推动了深度学习技术的进步,也为实际应用提供了更丰富的解决方案。

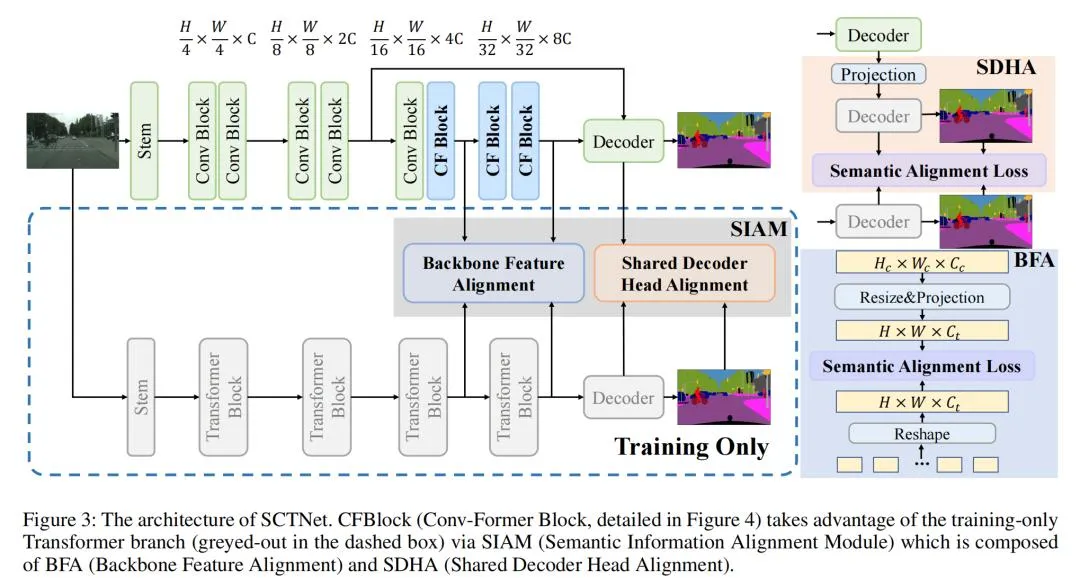

在计算机视觉领域,CNN-Transformer混合模型已经成为研究热点。例如,SCTNet提出了一种单分支卷积神经网络(CNN),该网络在训练时利用Transformer作为语义分支来提取丰富的长距离上下文信息,而在推理时仅部署单分支CNN。这种方法既保持了推理时的高效率,又能够利用Transformer捕获丰富的语义信息。实验结果显示,SCTNet在保持高推理速度的同时,实现了与现有最先进方法相比更高的准确性,为实时语义分割领域提供了新的速度-准确性权衡。

另一个创新方法是AdaMCT,它提出了一种新颖的混合模型,结合了卷积神经网络(CNN)和Transformer,用于序列推荐(SR)。AdaMCT通过将局部性偏好(通过CNN捕捉)和全局性偏好(通过Transformer捕捉)结合起来,更全面地建模用户的动态偏好。特别值得一提的是,AdaMCT引入了一种层级感知的自适应混合单元(AdaMCT),在不同层中解耦融合过程,提升表达能力,并自适应地聚合长期和短期偏好。这种方法在保持性能的同时,具有较少的参数和更高的计算效率,使得模型更适合实际部署,尤其是在资源受限的设备上。

在超分辨率任务中,Enriched CNN-Transformer Feature Aggregation Networks提出了一种结合卷积神经网络(CNN)和Transformer的混合网络,以聚合丰富的特征,包括CNN的局部特征和Transformer捕获的长距离多尺度依赖性。该方法通过引入跨尺度令牌注意力模块(CSTA),有效地提取和利用了多尺度特征,有助于恢复图像中的高频细节和纹理信息。值得注意的是,研究发现位置信息在SR任务中的重要性降低,因此提出的网络没有使用位置嵌入,这减少了计算复杂性。

CNN-Transformer混合模型之所以能够取得如此显著的性能提升,主要得益于以下几点:首先,CNN擅长有效地提取图像的局部特征,具有更好的泛化能力和更快的收敛速度;而Transformer则更擅长捕捉全局的语义信息,在大数据集上可以获得很好的效果。将两者结合,可以获得更好的表现。其次,通过知识蒸馏等方法,可以将CNN的归纳偏置特性引入Transformer模型中,降低Transformer模型对数据量的需求,提升训练速度。最后,通过创新的架构设计,如串并联拼接、局部替换等方法,可以充分发挥两种模型的优势,实现性能的全面提升。

展望未来,CNN-Transformer混合模型还有很大的发展空间。一方面,可以继续探索更高效的结合方式,如通过更精细的特征融合策略来进一步提升模型性能。另一方面,可以将这种混合方法应用到更多的领域,如自然语言处理、语音识别等,以解决更复杂的问题。随着研究的深入,我们有理由相信,CNN-Transformer混合模型将在未来的深度学习领域发挥越来越重要的作用。