大语言模型在图推荐系统中的融合与优化策略

发布时间:2024-09-19

大语言模型(LLM)正在重塑推荐系统的格局。Meta公司最近的研究显示,基于万亿参数的序列转换器模型在大规模工业系统中首次超越了传统推荐系统的召回和排序模块。这一突破性进展预示着LLM与图神经网络(GNN)的融合将成为推荐系统未来的重要发展方向。

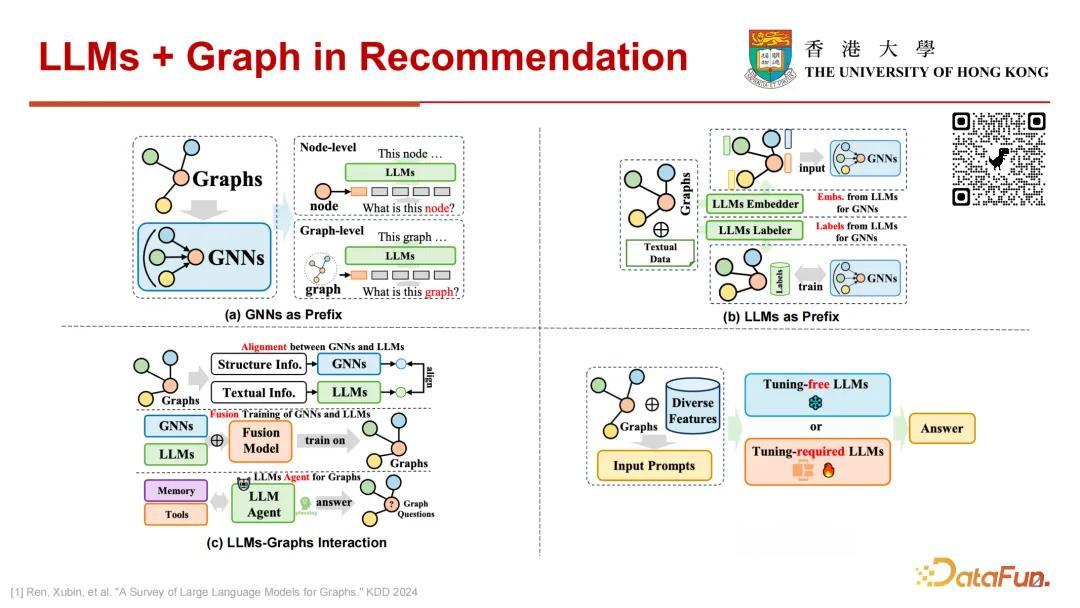

LLM与GNN的融合主要体现在三个方面:LLM作为预测器、校准器和编码器。当作为预测器时,LLM负责预测最终答案,可以将图的embedding和文本的embedding都输入LLM进行预测。例如,港大联合百度开源的通用图大模型GraphGPT,就是让大语言模型能够读懂图数据,从而实现更精准的预测。

作为校准器,LLM的作用是将图经过GNN处理后的输出与文本经过LLM处理后的输出进行对齐或校准。这种模式在处理富文本图时尤为有效,能够充分利用LLM的语义理解和推理能力,同时发挥GNN在图结构建模上的优势。

当LLM作为编码器时,它主要用于将文本经过LLM处理后的输出与图一起输入GNN,相当于为文本提供了一个强大的编码器,获得更高质量的特征向量。百度提出的GLEM框架就是一个典型案例,它通过文本编码器、图编码器和联合解码器的组合,实现了语言模型和图神经网络的有效融合。

LLM在图推荐系统中的应用带来了显著优势。首先,LLM具备强大的语义理解和生成能力,能够引入外部开放世界知识,丰富推荐系统的语义信号。其次,LLM具备跨域推荐能力,特别适合冷启动场景。此外,LLM的泛化能力有助于解决推荐系统中的长尾问题。

然而,LLM与图推荐系统的融合也面临着诸多挑战。首先是训练效率问题,LLM的参数量巨大,可能导致显存用量过大、训练时间过长。为了解决这一问题,研究者们提出了参数高效微调(PEFT)方案,以及调整模型更新频率等策略。

其次是推理时延问题,LLM的推理耗时难以满足推荐系统快速响应的要求。对此,一种可能的解决方案是预存部分输出或中间结果,以空间换时间。此外,通过蒸馏、剪枝、量化等方法降低推理模型的实际规模,也是一个有效的策略。

最后,推荐领域的长文本建模也是一个挑战。长用户序列、大候选集、多元特征都可能导致推荐文本过长,难以被LLM有效捕捉。解决这一问题的关键在于通过过滤、选择、重构等手段,提供真正简短有效的文本输入。

展望未来,LLM与图推荐系统的融合将朝着更加智能化、个性化的方向发展。我们可能会看到更多创新性的融合方法,如将LLM的思维链推理能力应用于图结构数据的启发式推理中。同时,随着硬件技术的进步和算法的优化,LLM在推荐系统中的应用将变得更加广泛和深入。

总的来说,LLM与图推荐系统的融合为推荐技术带来了新的机遇和挑战。通过充分发挥LLM的语义理解和推理能力,结合GNN在图结构建模上的优势,我们有望构建出更加智能、精准的推荐系统,为用户提供更好的个性化服务。