TensorFlow 1.3的Datasets和Estimator知多少?谷歌大神来解答

发布时间:2024-09-18

在TensorFlow 1.3版本中,谷歌引入了两个重要的新特性:Datasets和Estimator。这两个组件不仅简化了机器学习编程,还提高了模型训练和评估的效率。让我们来看看它们是如何工作的,以及为什么你应该在下一个项目中尝试使用它们。

Datasets简化数据处理

Datasets API提供了一种创建输入流水线的新方法。相比传统的feed_dict或基于队列的方法,Datasets API更加简洁易用。它允许你以声明式的方式描述数据处理流程,包括读取、预处理和批处理等步骤。

例如,假设我们有一个CSV文件,其中包含鸢尾花的四个特征(萼片长度、萼片宽度、花瓣长度和花瓣宽度)以及对应的标签。我们可以使用以下代码来创建一个数据集:

def my_input_fn(file_path, perform_shuffle=False, repeat_count=1):

def decode_csv(line):

parsed_line = tf.decode_csv(line, [[0.], [0.], [0.], [0.], [0.]])

label = parsed_line[-1:]

del parsed_line[-1]

features = parsed_line

d = dict(zip(feature_names, features)), label

return d

dataset = (tf.contrib.data.TextLineDataset(file_path)

.skip(1) # Skip header row

.map(decode_csv))

if perform_shuffle:

dataset = dataset.shuffle(buffer_size=256)

dataset = dataset.repeat(repeat_count)

return dataset

这段代码定义了一个输入函数,它读取CSV文件,解析每一行,并将其转换为特征和标签。我们可以将这个函数传递给Estimator,用于训练或评估模型。

Estimator简化模型创建

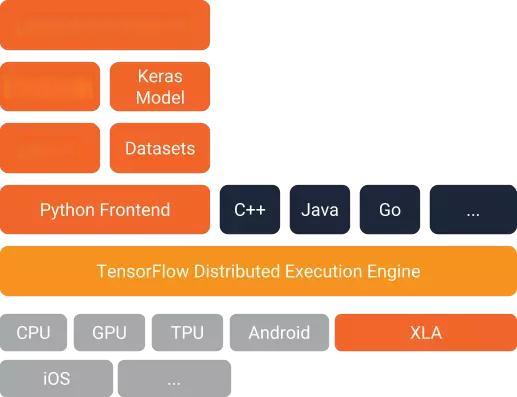

Estimator是一个高级API,用于创建和训练TensorFlow模型。它提供了一种统一的方式来定义、训练和评估模型,无论是在本地还是在分布式环境中。

要使用Estimator,你需要定义一个模型函数(model_fn),它描述了模型的结构和训练逻辑。例如,对于一个深度神经网络分类器,你的model_fn可能如下所示:

def model_fn(features, labels, mode):

# Define the model architecture

net = tf.feature_column.input_layer(features, feature_columns)

for units in hidden_units:

net = tf.layers.dense(net, units=units, activation=tf.nn.relu)

# Generate predictions (for PREDICT and EVAL mode)

logits = tf.layers.dense(net, n_classes, activation=None)

predictions = {

'class_ids': tf.argmax(input=logits, axis=1),

'probabilities': tf.nn.softmax(logits, name='softmax_tensor')

}

if mode == tf.estimator.ModeKeys.PREDICT:

return tf.estimator.EstimatorSpec(mode=mode, predictions=predictions)

# Calculate loss (for both TRAIN and EVAL modes)

loss = tf.losses.sparse_softmax_cross_entropy(labels=labels, logits=logits)

# Configure the Training Op (for TRAIN mode)

if mode == tf.estimator.ModeKeys.TRAIN:

optimizer = tf.train.AdamOptimizer(learning_rate=learning_rate)

train_op = optimizer.minimize(

loss=loss,

global_step=tf.train.get_global_step())

return tf.estimator.EstimatorSpec(mode=mode, loss=loss, train_op=train_op)

# Add evaluation metrics (for EVAL mode)

eval_metric_ops = {

'accuracy': tf.metrics.accuracy(labels=labels, predictions=predictions['class_ids'])

}

return tf.estimator.EstimatorSpec(mode=mode, loss=loss, eval_metric_ops=eval_metric_ops)

这个model_fn定义了模型的结构、损失函数、优化器以及评估指标。Estimator会根据这个函数自动处理训练、评估和预测的逻辑。

结合使用简化机器学习编程

Datasets和Estimator的结合使用,提供了一种简洁的方式来创建、训练和评估机器学习模型。你只需要定义数据读取逻辑和模型结构,剩下的工作交给Estimator来完成。

例如,要训练一个模型,你可以使用以下代码:

classifier = tf.estimator.Estimator(model_fn=model_fn, model_dir=model_dir)

# Train the model

classifier.train(input_fn=lambda: my_input_fn(train_file_path, perform_shuffle=True, repeat_count=None),

steps=num_train_steps)

这段代码创建了一个Estimator实例,指定了模型函数和模型目录。然后,它使用训练数据集(通过input_fn提供)来训练模型。

总结

Datasets和Estimator是TensorFlow 1.3中引入的两个强大工具,它们简化了数据处理和模型创建的过程。通过使用这两个组件,你可以更专注于模型的设计和优化,而不是繁琐的数据处理和训练循环。在你的下一个TensorFlow项目中,不妨尝试使用Datasets和Estimator,体验它们带来的便利。