Stable Diffusion 3比DALL-E 3更有料?

发布时间:2024-09-16

OpenAI近日悄然推出了DALL·E 3,这一新版本在图像生成技术上取得了重大突破。与此同时,Stable Diffusion 3的预览版也已亮相,官方宣布后续还将推出开源版本。作为当前AI绘画领域的两大热门模型,Stable Diffusion 3和DALL-E 3的对比成为了业界关注的焦点。

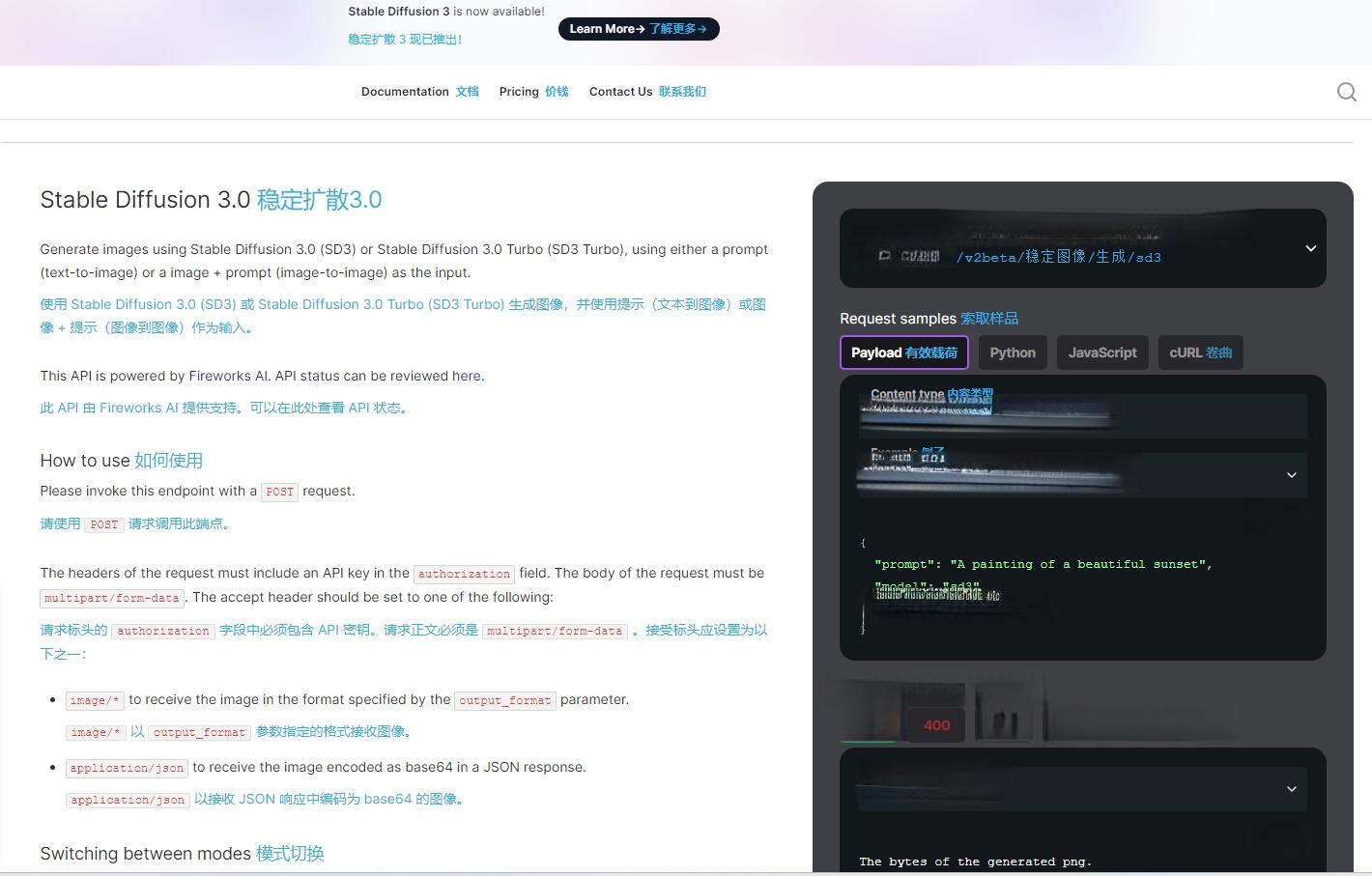

在技术原理方面,Stable Diffusion 3引入了两项核心技术:Diffusion Transformer和Flow Matching。Diffusion Transformer使用纯粹的Transformer结构,直接预测每一步去噪后的图像表征,从而提升生图性能和效率。Flow Matching则提供了一种新的生成模型框架,简化了连续正态化流(CNF)的训练过程。相比之下,DALL-E 3摒弃了unCLIP的模型设计思路,转而汲取了Imagen、Stable Diffusion等AI模型的精髓,打造出了新一代的“技术融合体”。DALL-E 3还引入了VAE结构和扩散模型解码器,进一步提升了图像生成质量。

在实际表现上,DALL-E 3展现出了明显的优势。在人物表现方面,DALL-E 3能够更加准确和细致地呈现面部特征、表情和服装细节。在文本细节还原方面,DALL-E 3也展现出了强大的能力,能够更准确地根据文本生成图像,并在图像中加入与文本相对应的细节。从目前有限的测试样例来看,DALL-E 3在绘画表现上不输于Midjourney 4,或许比Stable Diffusion XL要强。

然而,AI绘画模型的发展也引发了对艺术创作本质的思考。一方面,这些强大的AI工具为艺术家和创意工作者提供了更高效、更直观的创作过程;另一方面,过度依赖AI可能会导致人类失去某种创作的本真。正如一位艺术家所说:“AI可以生成令人惊叹的图像,但它无法真正理解情感和创造力的本质。”

展望未来,AI绘画模型的发展趋势可能是更加注重个性化和交互性。OpenAI已经宣布DALL·E 3将基于GPT-3.5构建,可以帮助用户优化提示词,甚至可以通过对话修改生成的图像。这种人机协作的方式可能会成为未来AI艺术创作的主要模式。

总的来说,Stable Diffusion 3和DALL-E 3各有特色,难以简单地判断谁更有料。Stable Diffusion 3在技术上进行了创新,提供了更灵活的模型选择;而DALL-E 3则在图像生成质量和细节还原方面展现出了明显优势。对于追求更高质量和更准确细节的用户来说,DALL-E 3无疑是一个更好的选择。但对于那些更注重模型灵活性和开源性的用户,Stable Diffusion 3可能更具吸引力。无论如何,这两种模型的出现都标志着AI绘画技术迈上了新的台阶,为艺术创作带来了无限可能。