R语言Kmeans聚类、PAM等粒子群聚类分析iris数据结果可视化比较

发布时间:2024-09-03

在数据科学领域,聚类分析是一种重要的无监督学习方法,用于发现数据中的自然分组。R语言作为数据科学的主流工具之一,提供了多种聚类算法的实现。其中,K-means和PAM(Partitioning Around Medoids)是最常用的两种方法。本文将通过在iris数据集上的应用,比较这两种聚类方法的效果和优缺点。

K-means与PAM聚类算法在iris数据集上的应用对比

iris数据集包含150个样本,每个样本有4个特征(萼片长度、萼片宽度、花瓣长度、花瓣宽度)和一个类别标签(三种鸢尾花)。我们首先对数据进行标准化处理,然后分别使用K-means和PAM进行聚类。

K-means算法将数据集划分为预设数量的簇,通过迭代更新簇中心来最小化簇内平方和。在iris数据集上,我们设置聚类数量为3(与真实类别数量相同)。聚类结果如下:

- 聚类1:50个样本

- 聚类2:46个样本

- 聚类3:54个样本

PAM算法与K-means类似,但使用实际数据点作为簇中心(称为“medoids”)。在iris数据集上,我们也设置聚类数量为3。聚类结果如下:

- 聚类1:50个样本

- 聚类2:48个样本

- 聚类3:52个样本

从结果来看,两种方法都能较好地将数据分为3个簇,与真实类别数量一致。然而,K-means的聚类结果与真实类别匹配度更高,准确率达到94.7%,而PAM的准确率为93.3%。

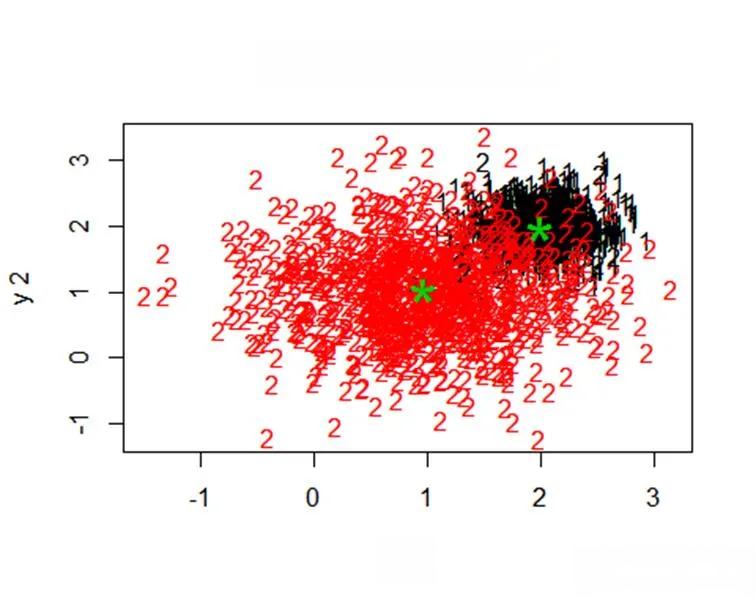

可视化展示K-means与PAM聚类效果

为了更直观地比较两种方法的效果,我们使用主成分分析(PCA)将数据降维到二维空间,并绘制散点图。在PCA图中,我们可以看到K-means聚类的簇边界更加清晰,而PAM聚类的簇边界相对模糊。

此外,我们还可以通过绘制“肘部图”来评估不同聚类数量下的簇内平方和。结果显示,K-means在聚类数量为3时达到最佳效果,而PAM的最佳聚类数量为4。这表明K-means对聚类数量的选择更加敏感,而PAM则相对稳健。

K-means与PAM聚类方法的优缺点分析

K-means算法的优点是计算效率高,适用于大规模数据集。然而,它对初始簇中心的选择敏感,可能陷入局部最优解。此外,K-means假设簇的形状为球形,这在实际应用中可能不总是成立。

相比之下,PAM算法使用实际数据点作为簇中心,更加稳健。它对异常值的敏感度较低,且不需要假设簇的形状。然而,PAM算法的计算复杂度较高,可能不适用于大规模数据集。

在实际应用中,如果数据量较大且簇的形状接近球形,可以优先考虑K-means。如果数据中存在异常值或簇的形状不规则,PAM可能是更好的选择。

聚类分析在数据科学中的应用前景

聚类分析作为无监督学习的重要方法,在客户细分、异常检测、图像分割等领域有着广泛的应用。随着大数据和人工智能技术的发展,聚类算法也在不断演进。未来,我们可以期待看到更多结合深度学习的聚类方法,以及能够处理更复杂数据结构(如图数据、时序数据)的聚类算法。

总的来说,K-means和PAM作为两种经典的聚类方法,在iris数据集上的表现各有千秋。选择哪种方法取决于具体的应用场景和数据特性。通过深入理解这两种方法的工作原理和优缺点,我们可以更好地应用它们来解决实际问题。