构建10万GPU集群的挑战与解决方案

发布时间:2024-09-16

在人工智能飞速发展的今天,构建10万GPU集群已成为各大科技巨头竞相追逐的目标。这种规模的集群不仅代表着前所未有的计算能力,更是推动AI技术突破的关键基础设施。然而,要成功构建和运营这样一个庞然大物,面临着巨大的技术和经济挑战。

电力供应是10万GPU集群面临的首要难题。根据SemiAnalysis的估计,一个10万H100 GPU集群的核心IT设备所需电力约为150兆瓦(MW)。这相当于一个小城市的用电量,远超单一数据中心的供电能力。为了满足如此庞大的电力需求,企业不得不将集群分散部署在多个建筑或整个园区中。X.AI甚至不得不在田纳西州孟菲斯将一座旧工厂改造成数据中心,以解决电力供应问题。

与电力供应紧密相关的是冷却技术。如此大规模的GPU集群会产生巨大的热量,如何有效散热成为一大挑战。传统的冷却方法可能难以应对,因此需要创新的冷却解决方案,如液冷技术等。这不仅增加了建设成本,也对数据中心的设计提出了更高要求。

网络架构的选择和优化是另一个关键问题。在如此大规模的集群中,如何高效地传输数据,减少通信延迟,成为提高整体性能的关键。目前,业界主要在以太网和InfiniBand之间权衡。以太网成本较低,但性能可能无法满足需求;InfiniBand性能优异,但成本高昂。一些企业选择折中的方案,如NVIDIA的Spectrum-X,以平衡成本和性能。

并行计算策略的选择也至关重要。大规模模型训练通常结合数据并行、张量并行和管道并行。腾讯云的星脉2.0网络支持超10万卡大规模组网,通过自研方式解决了网络问题。这种3D并行策略可以最大化FLOP利用率,同时解决内存限制和通信瓶颈。

可靠性是另一个不容忽视的问题。在如此大规模的系统中,任何单点故障都可能导致整个训练过程中断。因此,有效的检查点机制和快速恢复策略成为必要。一些企业通过定期保存模型状态,即使遇到故障也能从最近的检查点恢复,从而减少训练时间的损失。

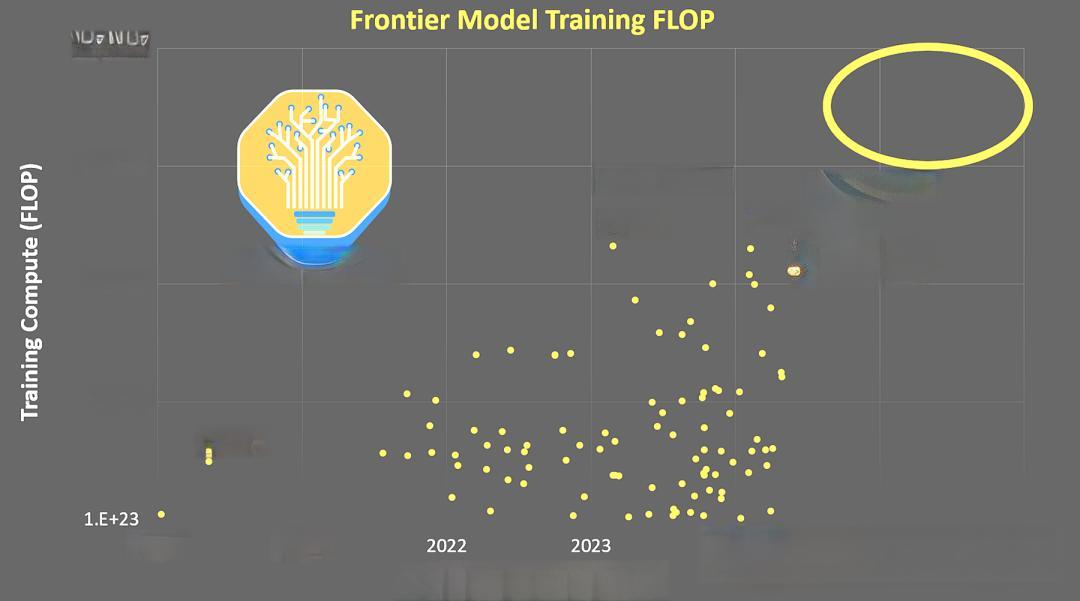

尽管面临诸多挑战,10万GPU集群的建设仍然如火如荼。OpenAI/Microsoft、xAI、Meta等大型AI实验室都在竞相构建这样的超级集群。一个10万H100 GPU集群的理论AI训练FLOPS峰值是2万A100集群的31.5倍。在理想条件下,这样的集群仅需4天就能完成相当于GPT-4的FP8训练量。

10万GPU集群的建设不仅是对技术的极限挑战,更是对未来AI发展方向的一次深远探索。随着对多模态学习的需求增加,如何在保持高能效比的同时,实现更大规模、更复杂模型的训练,将是未来几年AI研究的重要议题。这场竞赛不仅仅是技术的比拼,更是对创新策略、生态协作与可持续发展观的全面考验。