轻松搞懂机器学习深度学习—梯度下降详解

发布时间:2024-09-18

在机器学习的世界里,梯度下降算法就像是一个盲人在山谷中寻找最低点的过程。想象一下,这个盲人被困在一座大山的山顶,他的目标是找到山脚下的最低点。但是,由于大雾弥漫,他无法看到周围的环境,只能依靠手中的拐杖来感知脚下的坡度。

盲人开始行动了。他用拐杖敲打着地面,感知到脚下坡度最陡峭的方向。然后,他小心翼翼地朝着这个方向迈出一步。每走一步,他都会再次用拐杖探测周围的坡度,寻找新的下降方向。这个过程不断重复,直到他最终到达山脚的最低点。

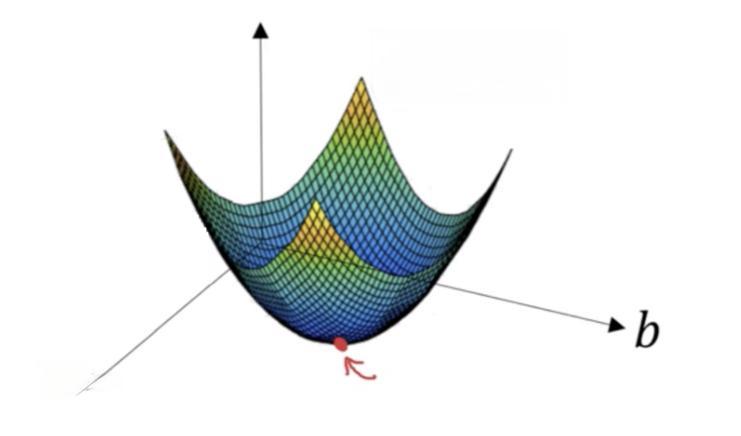

这个比喻生动地描述了梯度下降算法的核心思想。在机器学习中,我们通常需要找到一个函数的最小值,这个函数可以代表模型的损失或误差。梯度下降算法就像是那个盲人,通过不断调整参数(相当于盲人的脚步),逐步降低函数的值,直到找到最小值点。

在算法的具体实现中,有一个关键的概念叫做“学习率”。学习率就像是盲人每一步迈出的距离。如果学习率设置得太大,盲人可能会跨过最低点,甚至在山的两侧来回摇摆,就像我们比喻中的盲人如果步子迈得太大,可能会在山谷两侧来回跳跃,永远无法到达最低点。相反,如果学习率太小,盲人可能会花费很长时间才能到达最低点,就像学习率太小会导致算法收敛速度缓慢。

此外,梯度下降算法还面临着“局部最小值”的挑战。想象一下,如果山谷中有多个低洼处,盲人可能会误以为自己到达了最低点,但实际上只是陷入了一个局部的低洼处。在机器学习中,这种情况也很常见,特别是在处理复杂的非凸函数时。为了解决这个问题,我们通常会从不同的起点开始多次执行梯度下降,或者使用一些更高级的优化算法。

总的来说,梯度下降算法虽然看似简单,但它在机器学习和深度学习中扮演着至关重要的角色。通过这个盲人下山的比喻,我们可以更直观地理解梯度下降的工作原理,以及在实际应用中需要注意的关键点。无论是调整学习率,还是处理局部最小值的问题,都是我们在使用梯度下降算法时需要考虑的重要因素。