【机器学习】超参数与模型参数的区别

发布时间:2024-09-18

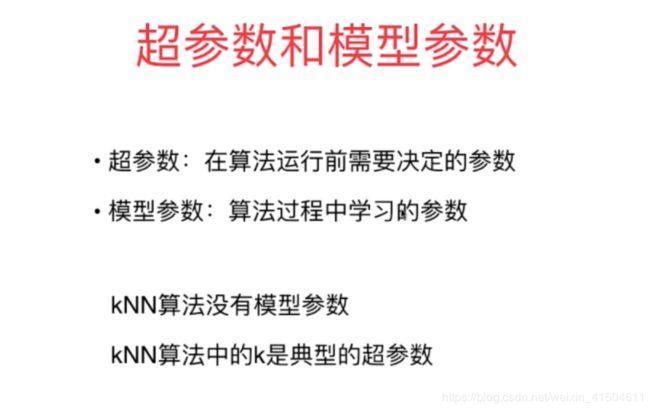

在机器学习领域,模型参数和超参数是两个核心概念,它们在模型训练和优化过程中扮演着截然不同的角色。理解这两种参数的区别,对于构建高效、准确的机器学习模型至关重要。

模型参数是模型内部的配置变量,它们直接从训练数据中学习得到。以神经网络为例,权重和偏差就是典型的模型参数。在训练过程中,这些参数通过梯度下降等优化算法不断调整,以最小化预测输出和实际输出之间的误差。例如,在一个简单的线性回归模型y = wx + b中,w(权重)和b(偏差)就是从数据中学习得到的模型参数。

相比之下,超参数是学习过程开始之前手动设置的外部配置。它们控制着模型的整体结构和行为,影响模型参数的学习方式。在神经网络中,超参数包括学习率、层数、每层神经元的数量等。这些参数需要在训练开始前由数据科学家或机器学习工程师根据经验手动设置。

超参数的选择对模型性能有着决定性的影响。例如,学习率决定了权重调整的速度。如果学习率设置得过高,模型可能会在最优解附近震荡,无法收敛;如果设置得过低,训练过程可能会变得非常缓慢。因此,选择合适的超参数集是机器学习实践中的一项关键任务。

超参数调整通常涉及将数据集拆分为训练集和验证集,使用不同的超参数组合训练模型,并评估模型在验证集上的性能。这个过程可能包括网格搜索、随机搜索或更复杂的贝叶斯优化等技术。例如,在神经网络训练中,可能需要尝试不同的学习率(如0.001、0.01、0.1)、不同的层数(如3层、5层、7层)和不同的批量大小(如32、64、128),以找到最佳的超参数组合。

理解模型参数和超参数的区别,对于有效构建和优化机器学习模型至关重要。模型参数通过数据学习得到,反映了模型对数据的理解;而超参数则需要根据经验和实验来设置,决定了模型的学习方式和结构。正确设置超参数可以帮助模型避免过拟合或欠拟合,提高其在新数据上的泛化能力。因此,对于机器学习从业者来说,掌握这两种参数的区别和调整方法,是构建强大、有效模型的关键。