37项SOTA!全模态预训练范式MiCo:理解任何模态并学习通用表示

发布时间:2024-09-18

港中文和中科院联合提出的一种名为MiCo的全模态预训练范式,在AI领域掀起了一场革命。这一方法在10种单模态感知基准、25种跨模态理解任务和18种多模态大模型问答基准上,共刷新了37项SOTA(State of the Art)记录,展现了其强大的性能。

全模态预训练旨在打破单一模态的局限,通过融合多种模态信息,实现更加全面和深入的智能理解。与传统的多模态预训练方法相比,MiCo能够处理更多种类的模态数据,包括图像、音频、视频、文本等,甚至可以扩展到3D内容、光流、IMU数据等。

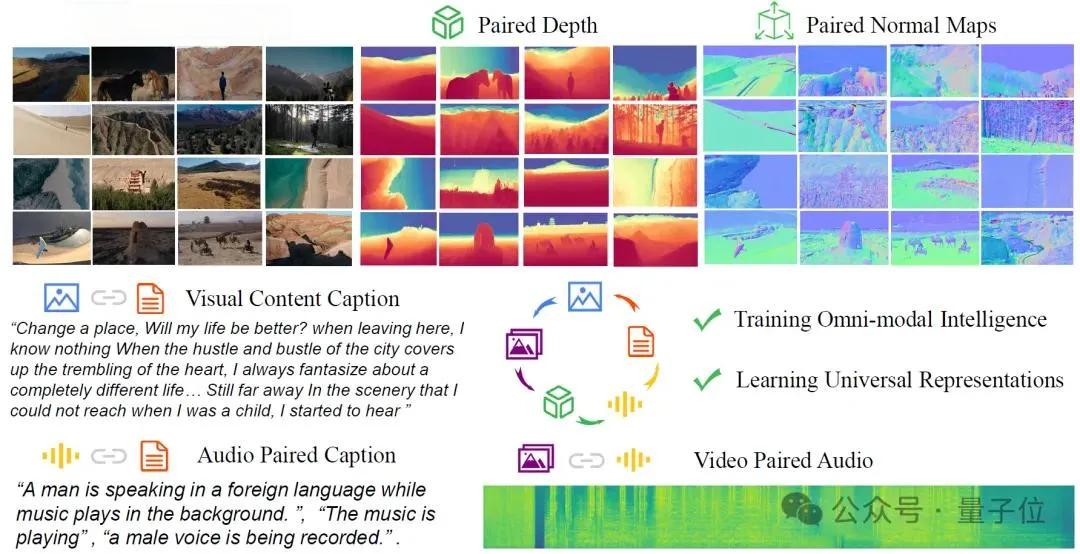

MiCo的核心设计理念来源于人脑的多模态认知过程。研究团队参考了理查德·梅耶的多媒体学习认知理论,将不同的模态分为“知识模态”和“接口模态”。知识模态主要来自原始传感器,如图像和深度图提供视觉知识,音频和视频提供听觉和时空知识;接口模态则以人类语言为代表,充当推理接口,促进学习、推理和知识的协调。

基于这一理念,MiCo设计了一个独特的神经网络结构,包括两个分支:一个用于处理知识模态,另一个专门处理接口模态,即自然语言。这种设计使得模型能够更好地理解和整合不同模态的信息。

在预训练过程中,MiCo通过构建多模态上下文来增强模型的学习能力。研究团队首先构建了多模态配对数据集,然后使用全模态编码器(ViT)提取多模态特征,再通过自上而下的设计构建多模态上下文关系。具体来说,他们为整个多模态Embeddings共享一套位置编码,以构建跨越不同模态的融合上下文关系;同时,对于特定模态的上下文,通过不同的模态标记来指示模态类别。

MiCo的创新之处还体现在其能够利用现有的大规模跨模态数据集进行联合预训练。通过跨数据集的联合采样和采样编码,MiCo成功地构建了更通用、更复杂的多模态上下文,从而实现了更好的泛化学习能力、更完善的模态扩展性和数据扩展性。

在实验结果方面,MiCo在多个任务上都取得了显著的性能提升。在10种单模态感知基准上,MiCo在7项上达到了SOTA;在25种跨模态理解任务中,包括检索、问答、描述等,MiCo在20项上刷新了记录;在18种多模态大模型问答基准上,MiCo也有10项SOTA的表现。

MiCo的出现标志着AI研究向着更全面、更智能的方向迈进了一大步。它不仅能够处理更多种类的模态数据,还能更好地理解和整合这些信息,为构建更强大的全模态基础模型奠定了基础。未来,MiCo有望在图像识别、语音识别、自然语言处理等多个领域发挥重要作用,推动AI技术的进一步发展。

MiCo的成功也为我们提供了重要的启示:在AI研究中,借鉴人脑的认知过程可以带来突破性的进展。通过模拟人类的多模态认知机制,我们可以设计出更智能、更灵活的AI系统。这不仅有助于提高AI的性能,还可能帮助我们更好地理解人类自身的认知过程。