跨平台 AI 基准测试工具推荐

发布时间:2024-09-02

随着人工智能技术的快速发展,跨平台AI基准测试工具正成为评估AI性能的关键手段。Geekbench ML和CRAB作为两个代表性的跨平台测试工具,正在引领这一领域的发展。

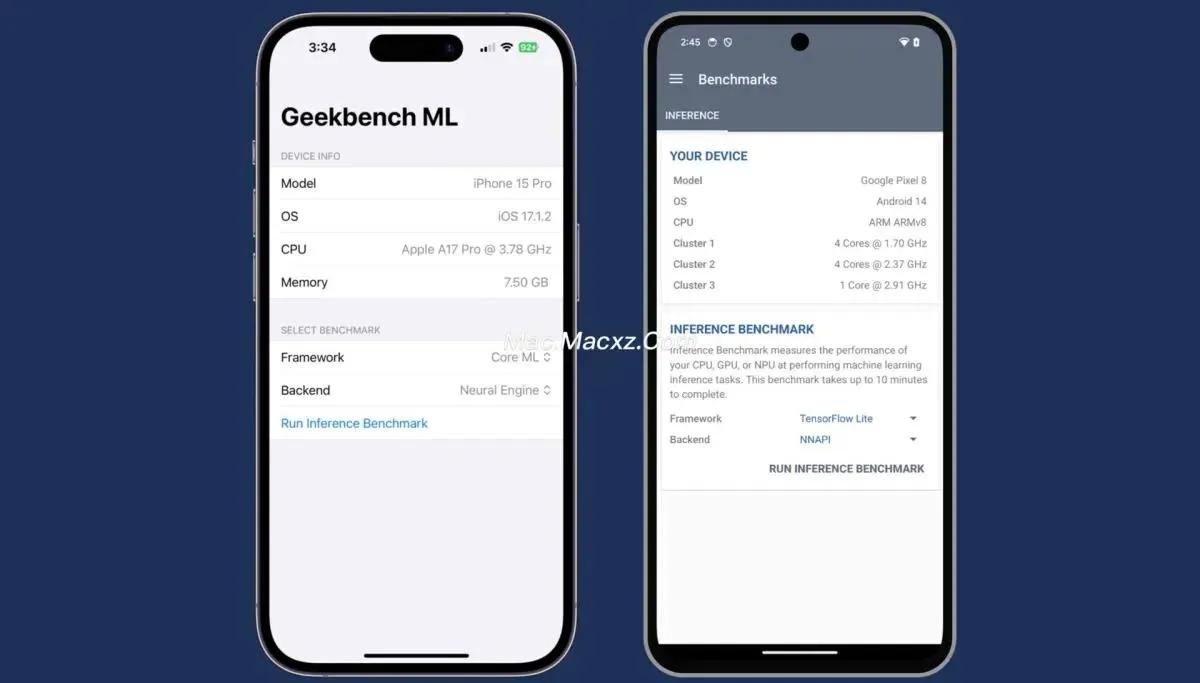

Geekbench ML是Primate Labs推出的跨平台AI基准测试工具,它使用真实世界的机器学习任务来评估AI工作负载的性能。该工具支持Android、iOS、macOS、Windows和Linux等多个操作系统,能够测量设备的CPU、GPU和NPU性能。Geekbench ML的测试内容包括计算机视觉和自然语言处理等机器学习任务,使用行业标准模型确保测试结果与AI应用程序性能相关。用户可以通过Geekbench ML了解设备是否能够顺畅运行最新的机器学习应用程序。

相比之下,CRAB(Cross-environment Agent Benchmark)是由CAMEL AI社区主导开发的跨平台多模态智能体基准测试框架。CRAB支持在PC和智能手机等跨平台环境中执行任务,能够模拟真实世界中人类用户同时使用多个设备完成复杂任务的场景。该框架采用基于图的细粒度评估方法,提供高效的任务和评估器构建工具。CRAB Benchmark-v0数据集涵盖了100个可以在PC和智能手机环境中执行的任务,包括传统的单平台任务和复杂的跨平台任务。

除了Geekbench ML和CRAB,还有其他值得关注的AI评测平台。例如,LMSYS Chatbot Arena是由伯克利大学主导团队LMSYS Org发布的一个大型语言模型(LLM)对抗评测平台。Open LLM Leaderboard是由Hugging Face推出的开源LLM和聊天机器人排行榜。MMLU Benchmark(Massive Multitask Language Understanding)是一个评估多任务语言理解模型性能的基准测试,覆盖了57个主题。

这些跨平台AI基准测试工具的出现,反映了AI技术正在向更加复杂和多元化的方向发展。它们不仅能够帮助开发者和用户了解AI模型的性能,还能推动AI技术的持续进步。随着更多跨平台测试工具的出现,我们有理由相信,未来的AI系统将能够更好地适应不同平台和环境,为用户提供更加智能和便捷的服务。