如何在联邦训练中跟踪模型性能指标

发布时间:2024-09-16

联邦学习作为一种新兴的分布式机器学习方法,正在迅速发展。它允许在不直接共享数据的情况下,通过多个设备或节点共同训练模型,从而实现数据隐私保护。然而,这种分布式特性也为模型性能指标的跟踪带来了新的挑战。

传统的集中式训练中,模型性能指标的跟踪相对简单。训练过程中的损失值、准确率等指标可以直接在中心服务器上收集和分析。但在联邦学习中,由于数据和模型训练分布在多个客户端,如何在保护数据隐私的同时有效地跟踪模型性能成为一个关键问题。

一种可行的方法是利用联邦平均(Federated Averaging, FedAvg)算法。FedAvg是联邦学习中最常用的优化算法,通过对客户端模型参数进行加权平均来实现全局模型的更新。我们可以在此基础上,设计一种性能指标的聚合机制。具体来说,每个客户端在本地训练模型时,除了计算模型参数外,还可以计算一些关键的性能指标,如训练损失、验证集准确率等。然后,这些指标可以与模型参数一起发送到中心服务器。在服务器端,我们可以对这些指标进行加权平均,得到全局模型的性能估计。

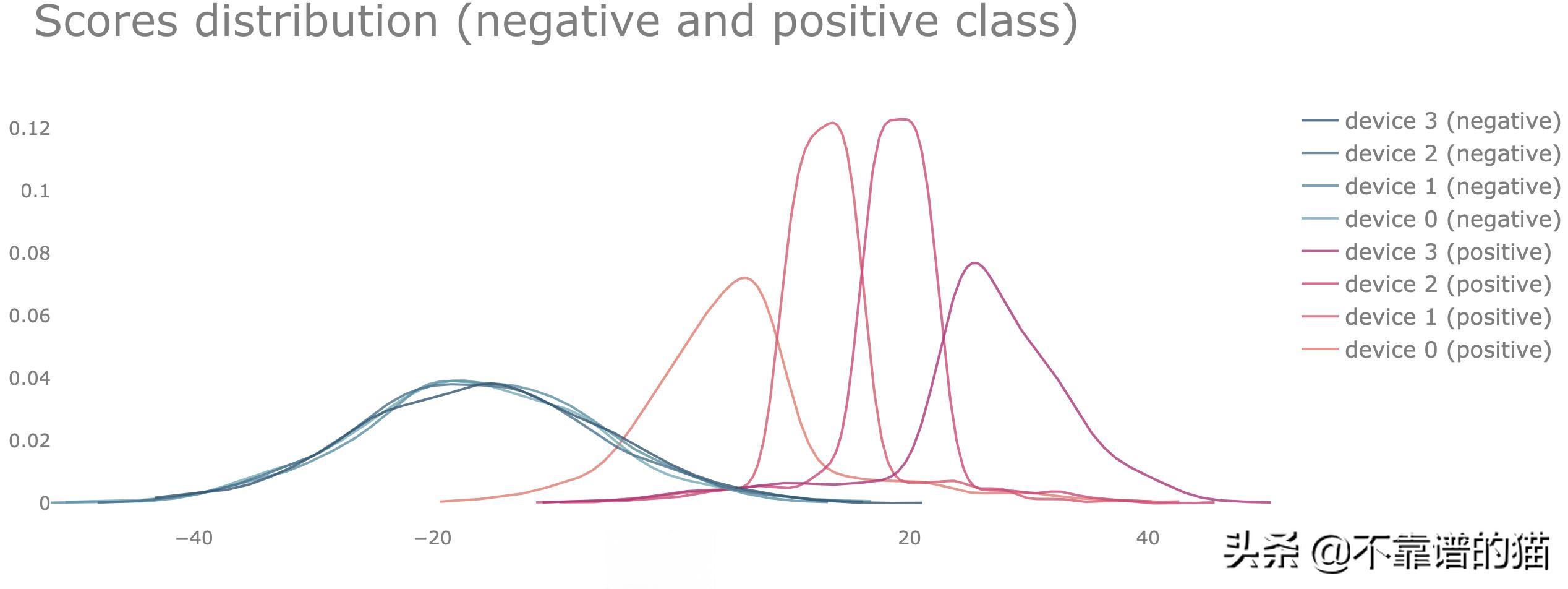

然而,这种方法仍然存在一些问题。首先,直接传输性能指标可能会泄露一些关于客户端数据的信息。为了解决这个问题,我们可以采用差分隐私技术对指标进行扰动,以保护数据隐私。其次,由于联邦学习中可能存在数据异质性,即不同客户端的数据分布可能存在差异,直接对性能指标进行加权平均可能无法准确反映全局模型的性能。针对这个问题,我们可以设计更复杂的聚合策略,例如基于每个客户端数据分布的加权方法。

除了性能指标的直接聚合,我们还可以利用联邦学习的特性来设计更创新的性能跟踪方法。例如,我们可以利用模型剪枝技术来优化性能评估过程。在联邦学习中,模型往往需要多轮次训练才能收敛。为了降低数据估值任务中的模型训练代价,我们可以设置一个性能提升的阈值。当模型性能提升波动小于这个阈值时,我们可以提前结束模型训练,从而节省计算资源。

此外,我们还可以利用贡献评估技术来优化联邦模型训练。通过评估每个参与方对模型性能的贡献,我们可以选择性地使用高质量数据,减少低质量或恶意数据对模型性能的负面影响。例如,我们可以根据参与方的贡献大小,调整其在联邦训练中的参与程度。或者,我们可以设置一个阈值,移除那些贡献较低的参与方,从而提高整体模型性能。

总的来说,在联邦学习中跟踪模型性能指标需要我们重新思考传统的集中式方法。我们需要在保护数据隐私和提高模型性能之间找到平衡点,利用联邦学习的特性设计创新的性能跟踪和评估策略。随着联邦学习技术的不断发展,我们相信会有更多有效的工具和方法出现,帮助我们更好地理解和优化联邦学习模型的性能。