强化学习:动态规划算法

发布时间:2024-09-02

动态规划算法是强化学习中解决马尔科夫决策过程(MDP)问题的重要工具。它通过迭代更新状态价值函数,逐步逼近最优策略,为后续更复杂的强化学习算法奠定了理论基础。

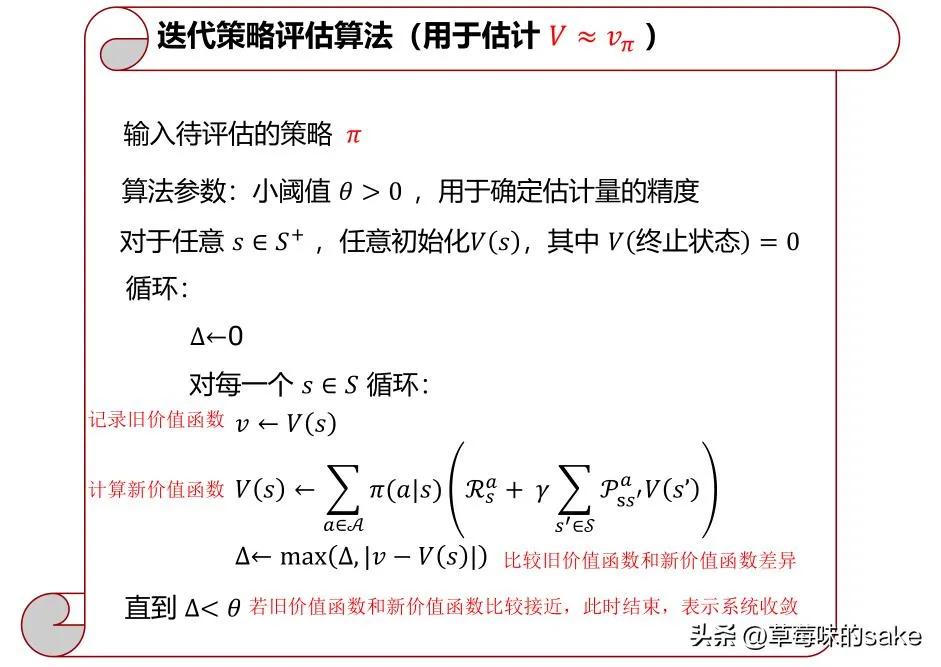

动态规划算法的核心思想是将复杂问题分解为一系列子问题,并利用子问题的解来构建原问题的解。在强化学习中,这个过程通常分为两个步骤:策略评估和策略提升。

策略评估(Policy Evaluation)旨在计算给定策略下的状态价值函数。以Cliff Walking环境为例,假设我们有一个4x12的网格世界,智能体从左下角出发,目标是到达右下角。每走一步奖励为-1,掉入悬崖奖励为-100。给定一个随机策略,我们可以通过迭代计算每个状态的价值,直到收敛。例如,对于左下角的状态,其初始价值可能为0,经过多次迭代后,最终价值可能会收敛到-7.712。

策略提升(Policy Improvement)则基于当前的价值函数,通过贪心策略来寻找更好的策略。在Cliff Walking环境中,我们可能会发现某些状态下,向右走比随机移动可以获得更高的期望回报。通过不断迭代策略评估和策略提升,最终可以得到最优策略。

策略迭代(Policy Iteration)和价值迭代(Value Iteration)是两种常用的动态规划算法。策略迭代包括两个交替进行的步骤:首先进行策略评估,然后进行策略提升。价值迭代则可以看作是一种简化版的策略迭代,它只进行一次策略评估就进行策略提升,从而加快了收敛速度。

以Cliff Walking环境为例,策略迭代可能需要进行多次策略评估才能收敛,而价值迭代可能只需要进行一次策略评估。在实践中,价值迭代通常比策略迭代更快收敛,但两者最终都能找到最优策略。

动态规划算法的优势在于它能够提供最优解,并且在理论上易于理解和实现。然而,它的局限性也很明显:首先,它需要完整的环境模型,包括状态转移概率和奖励函数,这在现实世界中往往难以获得。其次,随着状态空间的增加,动态规划算法的计算复杂度会急剧上升,面临“维数灾难”的挑战。

尽管如此,动态规划算法仍然是理解强化学习的基础。它为我们提供了一种系统化的方法来解决MDP问题,并启发了后续更复杂的无模型强化学习算法的发展。在某些特定领域,如游戏AI和资源分配问题中,动态规划算法仍然发挥着重要作用。