打破“维度的诅咒”,机器学习降维大法好

发布时间:2024-09-18

在机器学习领域,高维数据往往被视为一把双刃剑。一方面,丰富的特征可以提供更全面的信息;另一方面,过多的维度却可能导致“维度的诅咒”,给模型训练带来巨大挑战。面对这一困境,降维技术应运而生,成为打破“维度的诅咒”的关键利器。

“维度的诅咒”这一概念最早由Richard Bellman在1961年提出,指的是随着特征数量的增加,数据会变得更加稀疏,这可能导致模型训练的效率降低,以及预测性能的下降。在机器学习中,这一现象尤为明显。高维数据不仅增加了计算成本,还可能导致过拟合,使得模型在新数据上的泛化能力下降。

为了解决这一问题,研究人员开发了多种降维技术。其中,主成分分析(PCA)是最为广泛使用的方法之一。PCA通过线性变换将数据投影到由方差最大的方向所确定的坐标轴上,从而保留数据的主要特征。另一种常用的方法是线性判别分析(LDA),它特别适用于分类任务,通过最大化类别间的差异来降低维度。

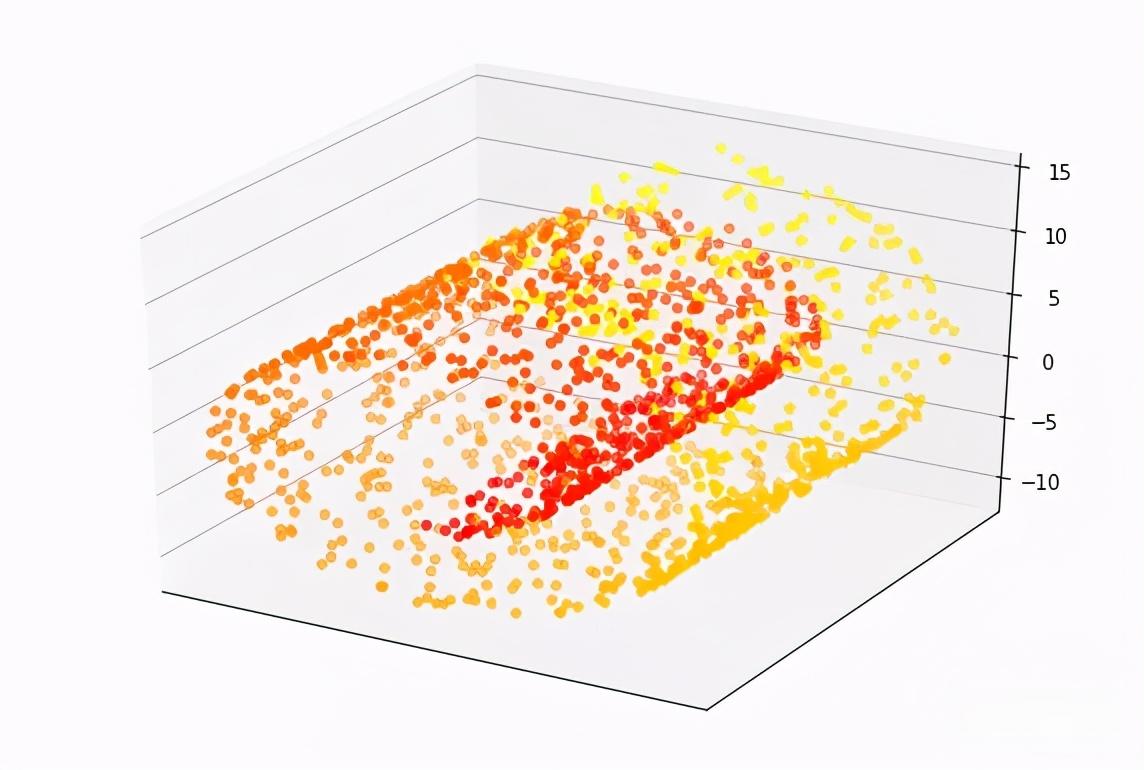

除了这些线性方法,还有一些非线性降维技术也值得关注。例如,t-分布邻域嵌入(t-SNE)主要用于数据可视化,它能够很好地保留数据点之间的局部相似性。对于深度学习爱好者来说,自编码器(Autoencoders)提供了一种基于神经网络的降维方法,能够学习到数据的有效低维表示。

选择合适的降维技术并非易事,需要根据具体问题和数据特性来决定。例如,在手写数字识别任务中,PCA可以将每个28x28的像素图像从784维降低到30维,显著提高分类性能。而在自然语言处理中,LDA则更适合于文本数据的降维和分类。

降维技术的成功应用案例不胜枚举。在图像处理领域,PCA可以用于图像压缩和特征提取,实现快速的存储和传输。在医疗诊断中,降维技术可以帮助从海量的生理数据中提取关键特征,提高诊断的准确率。在推荐系统中,降维可以有效减少用户-物品矩阵的稀疏性,提升推荐的精准度。

然而,降维技术并非万能良药。在降维过程中,不可避免地会损失一些信息。如何在降维效果和信息保留之间找到平衡,仍然是一个挑战。此外,随着数据规模和复杂性的增加,如何开发更高效的降维算法,也是未来研究的重要方向。

总的来说,降维技术为机器学习提供了一种强大的工具,帮助我们克服“维度的诅咒”,在高维数据中找到关键信息。通过合理选择和应用降维方法,我们可以显著提升模型的性能,为解决复杂问题开辟新的可能性。在未来,随着数据科学的不断发展,降维技术必将发挥更加重要的作用,助力我们更好地理解和利用海量数据。