清华团队推出新平台:用去中心化AI打破算力荒

发布时间:2024-08-29

清华大学背景的创业团队NetMind.AI近日推出了一款名为NetMind Power的去中心化AI平台,旨在解决当前AI领域面临的算力短缺问题。该平台通过整合全球闲置算力资源,为AI开发者提供高效且经济的算力解决方案,为打破“算力荒”提供了新的思路。

当前,AI大模型的快速发展对算力提出了前所未有的需求。据业内专家预估,OpenAI推出的Sora模型在训练环节大约需要在4200-10500张NVIDIA H100上训练1个月。如此庞大的算力需求,使得GPU供应难以满足AI产业的持续增长。与此同时,传统数据中心、中小企业以及个人用户中存在着大量闲置的算力资源,这些资源要么被闲置,要么被用于游戏、视频渲染等非AI领域。

面对这一挑战,NetMind Power平台通过去中心化的方式,将这些分散的算力资源整合起来,为AI开发者提供灵活、高效的算力服务。该平台的四大亮点值得关注:

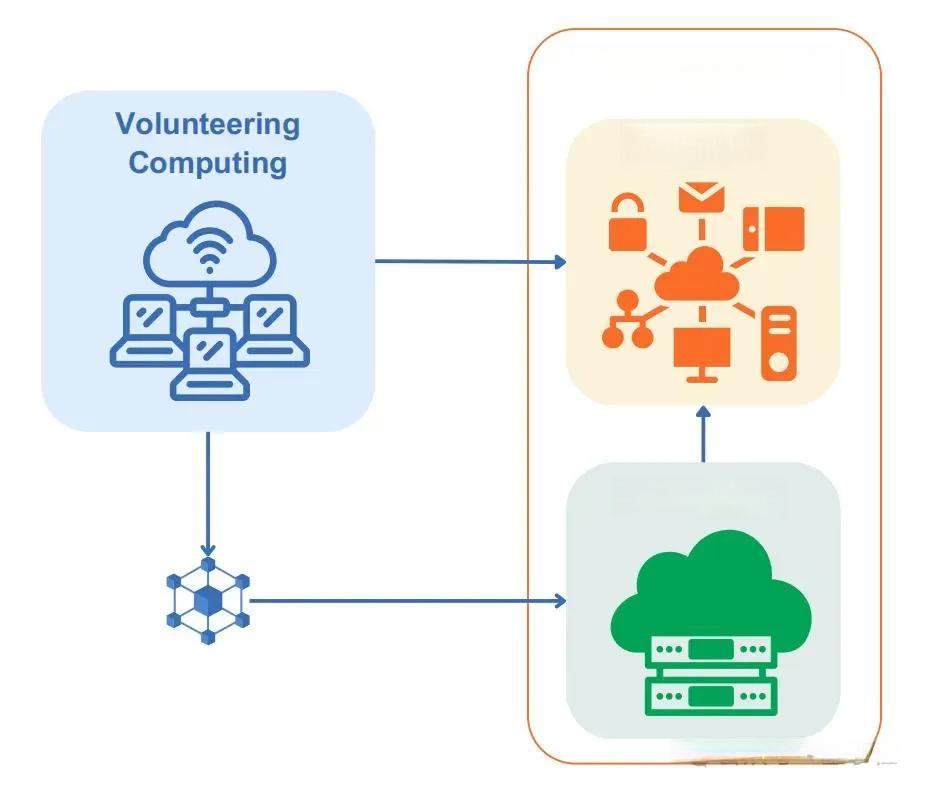

首先是去中心化动态集群技术。NetMind Power利用基于P2P的动态分布式集群技术,结合独特的路由、聚类算法及神经网络,将成千上万个计算节点编织成强大的网络集群架构。当用户在平台上进行AI相关操作时,平台能够在极短时间内在全球各地的计算节点中调配最合适的计算资源,为用户提供服务。这种去中心化的架构不仅提高了算力的利用效率,还增强了系统的稳定性和安全性。

其次是完整的AI生态。NetMind Power不仅提供基础算力服务,还囊括了开源模型库、AI数据集、数据与模型加密等AI生态基座,以及模型训练、推理、部署等全方位服务。这种MaaS(Model as a Service)平台大大降低了AI开发的门槛,特别是对于没有专业AI开发能力的中小企业和传统企业来说尤为重要。

第三是异步训练算法。NetMind Power通过自研的模型切分和数据异步技术,打破了分布式训练中网速和带宽的壁垒,使得分布在不同地理位置的训练节点能够同步参与到庞大的模型训练工作中。这项技术解决了传统分布式训练中对高带宽网络的依赖,极大地拓展了算力资源的利用范围。

最后是模型加密与数据隔离技术。NetMind Power提供了独特的模型加密技术,保障了在去中心化的志愿计算场景中用户的AI模型和数据安全。所有网络通信都经过加密处理,通过数据隔离与模型拆分确保任何单一节点无法获得完整数据和模型,大幅度提高了安全性。

NetMind Power平台的推出,标志着去中心化AI正在成为解决算力荒问题的重要途径。这种模式不仅能够有效利用全球闲置的算力资源,还能够打破少数科技巨头对算力的垄断,推动AI技术的普惠化和民主化。随着更多开发者和企业加入到这个去中心化的AI生态系统中,我们有理由相信,AI技术的发展将更加均衡、更加开放,最终造福于全人类。