机器人Transformer模型类算法

发布时间:2024-09-16

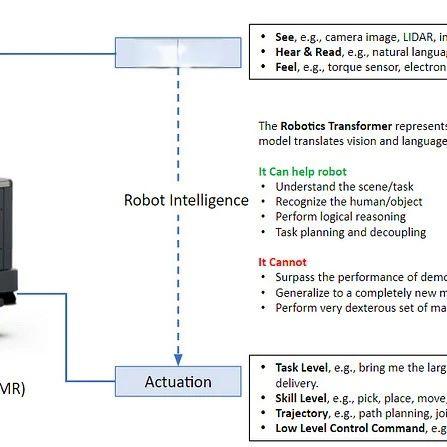

Transformer模型正在彻底改变机器人学习的格局。这种基于自注意力机制的神经网络架构不仅在自然语言处理领域取得了巨大成功,还在机器人视觉感知和交互能力方面带来了革命性的突破。

Transformer模型助力机器人视觉感知能力提升

在视觉感知方面,视觉Transformer模型展现出了强大的特征提取和泛化能力。以ViT(Vision Transformer)为代表的纯Transformer模型直接将图像分割为序列,通过自注意力机制学习像素间的全局依赖,在ImageNet等大规模数据集上取得了超越传统卷积神经网络(CNN)的性能。

在机器人领域,视觉Transformer模型可以用于构建更鲁棒、更通用的视觉感知模块。例如,OWL-ViT模型将ViT与开放词汇对象检测相结合,能够识别数百种未在训练集中出现的物体类别,为机器人系统提供了更广泛的物体理解能力。

多模态Transformer模型促进机器人语言理解

在自然语言处理方面,Transformer模型同样发挥着重要作用。大型语言模型如BERT、GPT-3等在处理文本数据时表现出色,能够理解复杂的语义关系和上下文信息。在机器人领域,这些模型可以用于处理用户指令、解释任务描述等自然语言输入。

更进一步,视觉-语言模型(Vision-Language Models)如CLIP(Contrastive Language-Image Pre-training)通过跨模态对比学习实现了视觉与语言的对齐。在机器人领域,这种模型可以用于根据文本描述动态生成视觉分类器,实现开放集识别。例如,CLIP-SAM模型采用CLIP作为视觉编码器,引入文本描述构建语义分割模型,能够泛化到新的物体类别和场景。

Transformer模型推动机器人端到端控制发展

除了感知和语言理解,Transformer模型还在机器人决策与规划方面展现出巨大潜力。例如,RT系列模型通过整合感知、决策制定和动作生成的框架,实现了机器人的端到端控制。这些模型能够处理图像和自然语言指令作为输入,支持机器人根据视觉和语言信息生成动作。

RT系列模型的探索方向包括自监督视觉预训练、多模态输入处理、泛化能力以及跨领域数据吸收能力。例如,RT-1模型使用大型数据集训练了具备可扩展性的模型,可以在变化的环境中保持稳健,并执行长期指令,实现在新任务上的适应性。

未来展望

Transformer模型在机器人领域的应用前景广阔。随着模型规模的不断扩大和训练数据的持续积累,我们有理由相信,未来的机器人将能够更好地理解复杂环境,与人类进行自然交互,并执行更复杂的任务。然而,要实现这一目标,我们还需要解决模型效率、泛化能力、安全性等方面的问题。无论如何,Transformer模型无疑正在引领机器人学习的新时代。